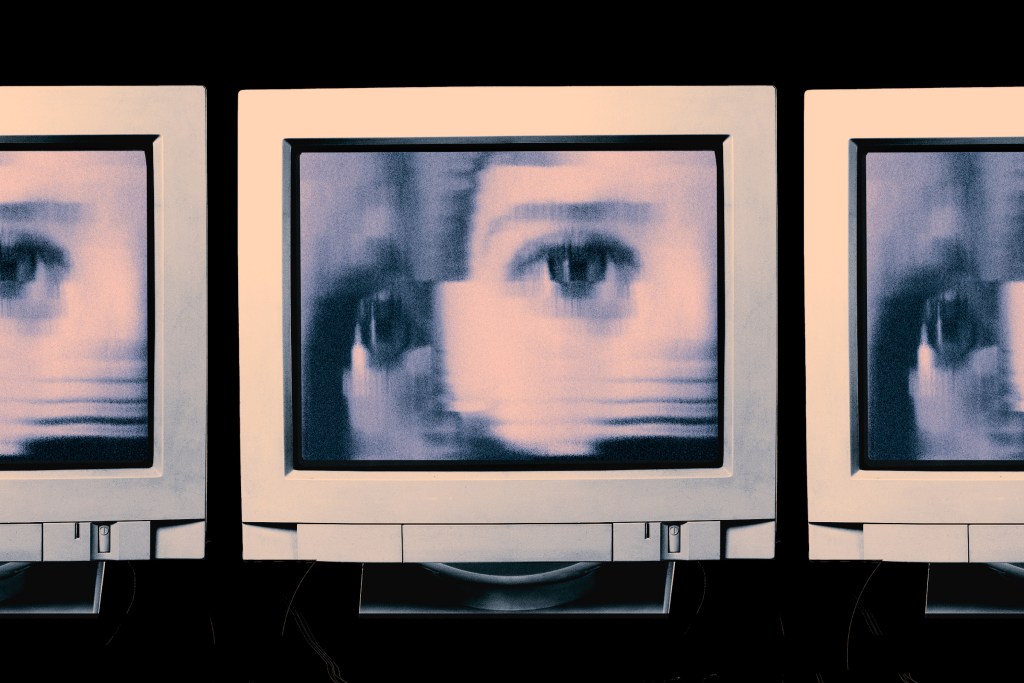

IWF 보고서, AI 아동 성착취물 영상 260배 폭증 — '해악에 한계는 없다'

영국 인터넷감시재단(IWF)이 2026년 3월 발표한 '한계 없는 해악(Harm Without Limits)' 보고서에 따르면, 2025년 한 해 동안 AI로 생성된 아동 성착취 영상이 3,443건으로 전년(13건) 대비 260배 폭증했습니다. 전체 8,029건의 AI 생성 아동 성착취물 중 65%가 최고 심각 등급(Category A)이며, 97%가 여아를 대상으로 한 것으로 나타났습니다.

IWF '한계 없는 해악' 보고서 — 핵심 통계

IWF는 유럽 최대의 온라인 아동 성착취물 신고·차단 기관으로, 매년 전 세계 인터넷에서 유통되는 아동 성착취물을 추적·분석합니다. 2026년 3월 23일 발표된 이번 보고서는 AI 기술이 아동 성착취에 어떻게 악용되고 있는지를 분석관들의 시선으로 생생하게 담아냈습니다.

보고서의 핵심 수치는 충격적입니다. 2025년 한 해 동안 IWF가 확인한 AI 생성 아동 성착취물은 총 8,029건이며, 이 중 영상은 3,443건으로 전년(13건) 대비 26,385%(260배) 증가했습니다. 특히 영상 중 65%(2,233건)가 가장 극단적인 Category A로 분류되었는데, 이는 비 AI 영상의 Category A 비율(43%)보다 훨씬 높은 수치입니다. AI가 단순히 양적 증가만 초래한 것이 아니라, 더 극단적이고 잔혹한 콘텐츠의 생성을 가속화하고 있다는 의미입니다.

IWF CEO 케리 스미스(Kerry Smith)는 '우리는 이제 전례 없는 용이함으로 무한한 침해를 생성할 수 있는 기술적 환경에 직면해 있다'고 경고했습니다. AI 생성 아동 착취물의 97%가 여아를 대상으로 하고 있어, 이 문제가 극도로 젠더화된 폭력이라는 점도 다시 한번 확인되었습니다.

AI가 아동을 착취하는 3가지 방법 — Thorn 연구 분석

디지털 아동 보호 비영리단체 Thorn의 연구에 따르면, AI는 세 가지 뚜렷한 방식으로 아동 성착취에 무기화되고 있습니다. 첫째, '과거 피해자 재착취(Revictimization)'입니다. 가해자들이 기존에 유통되던 아동 학대 이미지에 AI를 적용해 자신을 삽입하거나 새로운 장면을 생성합니다. 이미 피해를 입은 아동이 AI를 통해 반복적으로 다시 피해를 입는 구조입니다.

둘째, '무해한 이미지의 무기화'입니다. 학교 축구팀 사진, SNS에 올린 가족 사진 등 완전히 무해한 이미지가 수 분 만에 성착취물로 변환됩니다. Thorn 리서치 부사장 멜리사 스트뢰벨(Melissa Stroebel)은 '아이가 더 이상 이미지를 공유하지 않아도 착취의 표적이 될 수 있다'고 경고했습니다. LoRA(Low-Rank Adaptation) 기술을 사용하면 20장의 사진과 15분이면 특정 아동의 사실적인 딥페이크를 생성할 수 있다고 IWF 보고서는 밝혔습니다.

셋째, '신고 인프라 과부하'입니다. 미국 실종·착취아동센터(NCMEC)는 2025년 1~9월 사이에만 AI 관련 아동 착취 신고 100만 건 이상을 접수했습니다. 이는 2023~2024년 합산 대비 600% 증가한 수치입니다. AI가 생성한 이미지는 기술적으로 매번 새로운 이미지이기 때문에, 기존의 해시 기반 탐지 기술(디지털 지문)로는 식별이 불가능합니다. NCMEC의 팰런 맥널티(Fallon McNulty)는 '생성되는 콘텐츠의 거의 구별 불가능한 특성이 피해자 식별을 극도로 어렵게 만든다'고 밝혔습니다.

글로벌 입법 대응 현황 — 45개 주, 영국, EU의 움직임

이러한 위기에 대응하여 전 세계적으로 입법이 가속화되고 있습니다. 미국에서는 45개 주가 AI 딥페이크 친밀 이미지를 다루는 법률을 제정했으며, 연방 차원에서는 Take It Down Act가 2026년 5월 19일 시행을 앞두고 있습니다. 이 법은 플랫폼에 48시간 내 비동의 딥페이크 삭제 의무를 부과합니다. 또한 DEFIANCE Act는 피해자가 딥페이크 제작자를 상대로 민사소송을 제기할 수 있는 법적 근거를 마련했습니다.

영국은 2025년 2월 세계 최초로 AI 아동 성착취 이미지 생성 도구(CSA image-generator)의 제작·소지 자체를 형사범죄로 규정했습니다. 이는 기존의 '이미지 소지' 처벌을 넘어 '생성 도구' 자체를 금지하는 획기적인 조치입니다. EU는 디지털 옴니버스를 통해 AI법을 개정하며 비동의 성적 이미지 및 CSAM 생성 AI를 명시적으로 금지하는 조항을 추가했습니다.

그러나 법 집행의 현실은 여전히 난관에 봉착해 있습니다. NBC 뉴스에 따르면 3년간 22개 주에서 AI 생성 CSAM과 관련된 형사 사건은 36건에 불과했습니다. 아이다호주에서는 등록 성범죄자가 Bashable.art의 '무제한 모드'를 사용해 10~11세 아동 포르노 1,000장 이상을 생성한 사건이 적발되었고, 노스캐롤라이나주에서는 학교 행사에서 찍은 미성년자의 옷 입은 사진을 AI로 성적 이미지로 변환한 남성이 40년 형을 선고받았습니다.

한국의 현실 — 17명 중 1명의 청소년이 딥페이크 피해 경험

한국의 상황도 글로벌 추세와 궤를 같이하고 있습니다. 2024년 디지털성범죄피해자지원센터의 지원을 받은 피해자가 사상 처음 1만 명을 돌파했으며, 합성·편집(딥페이크) 피해는 전년 대비 227% 폭증했습니다. 경찰청 사이버성폭력 집중단속 1년 결과 3,557명이 검거되었고, 이 중 딥페이크 범죄가 1,553건으로 최다를 차지했습니다. 가장 충격적인 것은 피의자의 62%가 10대라는 사실입니다.

Thorn의 글로벌 조사에 따르면 청소년 17명 중 1명이 직접 딥페이크 이미지 피해를 경험했으며, 8명 중 1명은 피해를 당한 지인이 있다고 응답했습니다. 한국은 시큐리티 히어로의 2023년 보고서에서 딥페이크 포르노 등장 인물의 53%가 한국인으로 확인되어, 세계에서 가장 취약한 국가로 지목된 바 있습니다. 성평등가족부가 2026년 3월 도입한 AI 자동탐지·삭제 시스템이 25일 만에 아동 성착취물 수집 2.7배, 유인정보 80배 증가라는 성과를 거둔 것은 그나마 긍정적인 신호입니다.

전문가 경고 — '빙산의 일각에 불과하다'

Thorn 리서치 부사장 멜리사 스트뢰벨은 Fortune 인터뷰에서 '우리가 보는 숫자는 빙산의 일각에 불과하다'고 강조했습니다. 실제로 AI 생성 성착취물의 상당수는 다크넷과 비공개 채널에서 유통되며, IWF나 NCMEC의 탐지 범위 밖에 있습니다. 2023년 단일 다크웹 포럼에서 한 달 만에 AI 생성 아동 착취 이미지 2만 장이 발견된 사례가 이를 방증합니다.

스탠포드대 리아나 페퍼콘(Riana Pfefferkorn) 연구원은 오픈소스 AI 모델의 위험성을 지적합니다. '오픈소스 모델은 떠돌아다니며 로컬에서 계속 학습될 수 있어 법 집행을 회피한다'는 것입니다. 실제로 위스콘신주에서는 범죄자가 Stable Diffusion에 특수 애드온을 설치해 사실적인 아동 이미지를 생성한 사건이 적발되었습니다. 미국 국토안보수사국(HSI) 사이버범죄센터의 마이클 프라도(Michael Prado)는 '우리를 놀라게 한 것은 이것이 얼마나 빠르게 확산되었는가'라고 말했습니다.

IWF의 이번 보고서는 AI 기술이 아동 보호의 근본적인 패러다임을 바꾸고 있음을 보여줍니다. 과거에는 '이미 존재하는' 학대 이미지의 유통을 차단하는 것이 핵심이었지만, 이제는 '존재하지 않는' 학대 이미지가 무한히 생성될 수 있는 시대가 되었습니다. 피해 아동이 실재하든 AI가 만들어낸 허구이든, 이 콘텐츠가 실제 아동에 대한 성적 태도와 행동을 정상화하고 촉진한다는 점에서 위험은 동일합니다. 기술적 탐지, 법적 처벌, 교육적 예방이 동시에 이루어지지 않는 한, '해악에 한계는 없다'는 IWF의 경고는 현실이 될 것입니다.